La brújula de la IA en la EU

Xime Amado ·

La brújula europea

Una guía para entender cómo Europa clasifica los riesgos de la inteligencia artificial — y qué está en juego.

La inteligencia artificial dejó de ser una promesa de laboratorio. Está en el buscador que resume respuestas antes de que termines de escribir la pregunta, en el banco que detecta fraudes en milisegundos, en el hospital que analiza imágenes médicas, en la escuela que personaliza ejercicios y en la empresa que filtra currículos antes de que un humano los vea. La pregunta ya no es si vamos a convivir con la IA. La pregunta es con qué mapa.

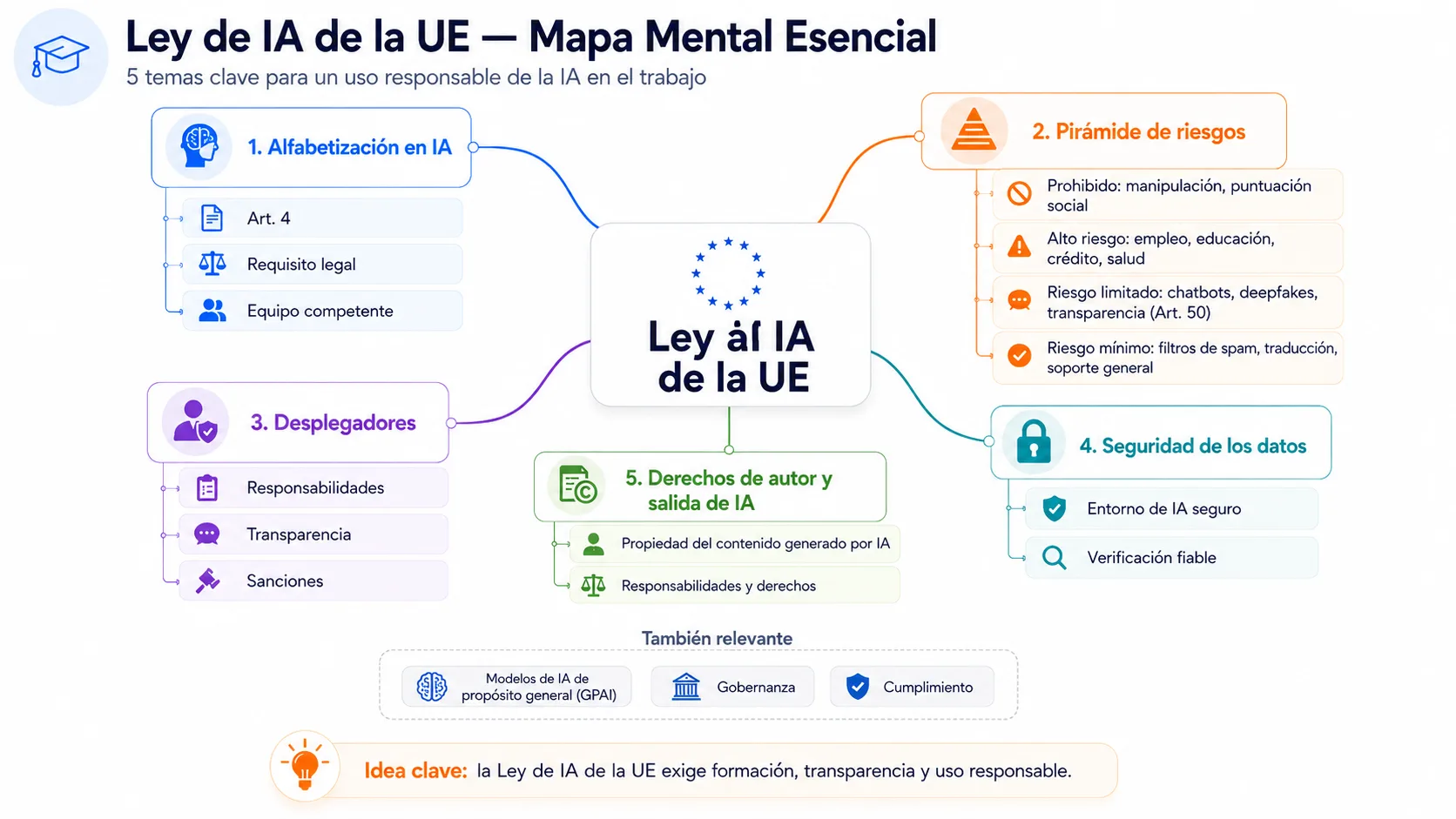

En Europa, ese mapa se llama AI Act. La ley entró en vigor el 1 de agosto de 2024 y seguirá aplicándose por fases hasta 2026 y 2027, con algunas obligaciones ya activas, como las prácticas prohibidas, la alfabetización en IA y las reglas para modelos de propósito general. [^1] Parte de una premisa sencilla: no todos los usos de la IA tienen el mismo peso.

Una clasificación de consecuencias, no de tecnología

Una app que recomienda música no se parece a un sistema que puede influir en un diagnóstico, un crédito, una plaza escolar o una contratación. Por eso la UE propone clasificar la IA no solo por lo que es, sino por lo que puede hacerle a alguien.

La Comisión Europea describe su enfoque como una combinación de excelencia y confianza: impulsar investigación, capacidad industrial e innovación, pero también seguridad, derechos fundamentales y supervisión. [^2] En la práctica, ese enfoque se traduce en una escala de riesgo.

En la base están los usos de riesgo mínimo: recomendaciones, filtros de spam, videojuegos y herramientas cotidianas de bajo impacto. No son el centro de la preocupación regulatoria.

Un nivel arriba está el riesgo limitado. La clave aquí es la transparencia: si alguien habla con un chatbot, debe saber que no conversa con un humano. Si un contenido fue generado por IA, debe poder identificarse. La norma no exige que pares; exige que lo digas.

El nivel crítico es el alto riesgo. Ahí entran sistemas usados en salud, empleo, educación, justicia, seguridad o servicios esenciales: áreas donde un error no solo incomoda. Puede cerrar una puerta. El AI Act exige, en estos casos, gestión de riesgos, datos de calidad, documentación técnica, controles de seguridad y supervisión humana. [^3]

En la cima están los usos de riesgo inaceptable: prácticas consideradas especialmente dañinas porque pueden vulnerar derechos fundamentales. Entre ellas están la puntuación social y ciertos usos de identificación biométrica o reconocimiento emocional en contextos sensibles. [^4]

La regla de lectura es sencilla: cuanto mayor es el impacto de una herramienta sobre una persona, más estricto es el control que se le exige.

La tensión que nadie quiere nombrar

El punto más interesante del AI Act no está solo en sus definiciones. Está en la contradicción que intenta sostener.

Europa quiere regular. Pero también quiere competir. Y esa segunda parte suele perderse en la conversación.

Mientras Estados Unidos, China y buena parte del mercado global empujan la IA a la velocidad de las plataformas, el capital de riesgo y la acumulación de talento, la UE intenta construir una vía más ordenada. Esa apuesta tiene una virtud evidente: protege. También tiene un riesgo real: si las reglas se vuelven demasiado pesadas o lentas, pueden dejar a Europa mirando cómo otros convierten la tecnología en negocio, infraestructura y poder geopolítico.

Por eso el enfoque europeo no se agota en la norma. La Comisión también habla de inversión pública, formación de talento, acceso a datos, supercomputación, AI Factories y apoyo directo a startups y pymes. El AI Continent Action Plan busca que Europa sea más competitiva en IA y que la tecnología llegue a sectores como salud, educación, industria y sostenibilidad ambiental. [^2] Las AI Factories, por su parte, están pensadas para dar acceso a infraestructura de cómputo, talento y servicios de innovación, con prioridad para startups y pymes. [^5]

La apuesta es que la tecnología no quede atrapada en documentos oficiales ni en laboratorios, sino que llegue a hospitales, industrias, escuelas, administraciones y pequeñas empresas. El objetivo declarado no es frenar la carrera, sino correr con un tablero más legible.

Si eso es posible —regular sin frenar, proteger sin excluir— es la pregunta que el propio AI Act tendrá que responder en los próximos años. La ley existe. La implementación será la prueba.

Lo que cambia para las personas

Para cualquier ciudadano, lo importante no está en el lenguaje técnico de la regulación. Está en la consecuencia diaria.

Si una IA ayuda a recomendar una película, el margen de error es pequeño y el costo de equivocarse, bajo. Si ayuda a decidir quién recibe una oportunidad laboral, una aprobación de crédito o un diagnóstico médico, la historia cambia por completo. Ahí ya no basta con decir que “el algoritmo lo decidió”. Tiene que haber explicación, posibilidad de revisión y, cuando corresponda, responsabilidad.

La IA no tiene un lado oscuro propio. No se despierta con intenciones. Los problemas aparecen en otro lugar: en los datos mal escogidos, en los sistemas presentados como infalibles, en las organizaciones que automatizan sin revisar, en los gobiernos que despliegan tecnología sin contrapesos y en los usuarios que la convierten en herramienta de manipulación. La inteligencia artificial no trae una moral incorporada. Amplifica la de quienes la diseñan, la compran y la aplican.

Una señal en una carretera llena de tráfico

Esa es, quizá, la mejor lectura del AI Act: no es una medalla ética ni un freno al futuro. Es un intento de poner señales en una carretera que ya está llena de tráfico y que nadie construyó con plano.

La IA seguirá avanzando, con Europa o sin ella. La pregunta es si lo hará como una caja negra —opaca, inauditable, sin apellido— o como una herramienta suficientemente clara como para que, cuando afecte la vida de alguien, la responsabilidad humana no desaparezca detrás de la máquina.

La brújula europea apunta a eso: una IA útil, competitiva y lo bastante transparente para que el error pueda encontrarse, corregirse y atribuirse.

Aprende y certifícate

Si este tema te interesa y quieres entender cómo aplicar estas reglas en empresas, plataformas, productos digitales o proyectos de IA, puedes hacer el curso y certificarte en www.actactact.com.

La IA ya está cambiando el mundo digital. Entender sus reglas empieza a ser una ventaja profesional.

Fuentes de información

[^1]: Comisión Europea, “AI Act”.

https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

[^2]: Comisión Europea, “European approach to artificial intelligence”.

https://digital-strategy.ec.europa.eu/en/policies/european-approach-artificial-intelligence

[^3]: Comisión Europea, “Navigating the AI Act”.

https://digital-strategy.ec.europa.eu/en/faqs/navigating-ai-act

[^4]: Comisión Europea, “Guidelines on prohibited artificial intelligence practices, as defined by the AI Act”.

https://digital-strategy.ec.europa.eu/en/library/commission-publishes-guidelines-prohibited-artificial-intelligence-ai-practices-defined-ai-act

[^5]: Comisión Europea, “AI Factories”.

https://digital-strategy.ec.europa.eu/en/policies/ai-factories