Der KI-Kompass der EU

Xime Amado ·

Ein Leitfaden zum Verständnis der europäischen Risikoklassifizierung für künstliche Intelligenz — und was dabei auf dem Spiel steht.

Künstliche Intelligenz ist längst kein Laborversprechen mehr. Sie steckt in der Suchmaschine, die Antworten zusammenfasst, bevor man die Frage zu Ende getippt hat, in der Bank, die Betrug in Millisekunden erkennt, im Krankenhaus, das medizinische Bilder auswertet, in der Schule, die Übungen individuell anpasst, und im Unternehmen, das Bewerbungen filtert, bevor ein Mensch sie je zu Gesicht bekommt. Die Frage ist nicht mehr, ob wir mit KI zusammenleben werden. Die Frage ist: mit welcher Karte.

In Europa heißt diese Karte KI-Verordnung — der AI Act. Und sie geht von einer Prämisse aus, die offensichtlich erscheint, die aber kaum eine Gesetzgebung je wirklich ernst genommen hat: Nicht alle Einsatzbereiche von KI haben dasselbe Gewicht.

Eine Klassifizierung nach Folgen, nicht nach Technologie

Eine App, die Musik empfiehlt, hat wenig gemein mit einem System, das eine Diagnose, eine Kreditentscheidung, einen Schulplatz oder eine Einstellungsentscheidung beeinflussen kann. Deshalb verfolgt die EU einen strukturell anderen Ansatz als andere Regulatoren: KI wird nicht danach klassifiziert, was sie ist, sondern danach, was sie jemandem antun kann.

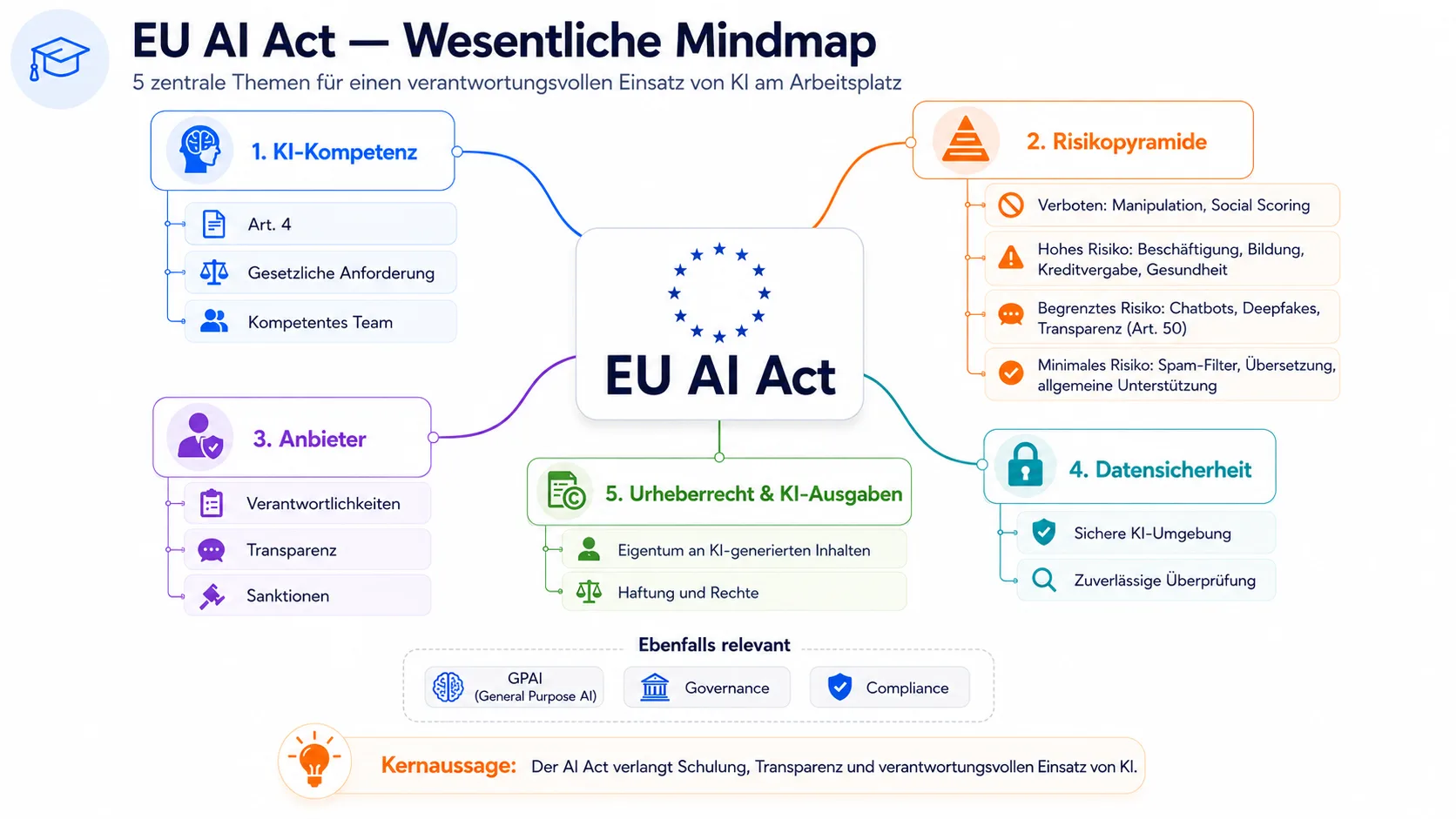

Die Europäische Kommission beschreibt den Ansatz als Kombination aus Exzellenz, Vertrauen, industrieller Leistungsfähigkeit, Sicherheit und Grundrechten. In der Praxis ergibt das vier Risikostufen.

An der Basis stehen minimale Risiken: Empfehlungssysteme, Spam-Filter, Videospiele, alltägliche Werkzeuge mit geringer Wirkung. Keine spezifischen Pflichten.

Eine Stufe darüber liegt das begrenzte Risiko. Hier ist Transparenz entscheidend: Wer mit einem Chatbot spricht, muss wissen, dass er nicht mit einem Menschen kommuniziert. Wurde ein Inhalt von KI erzeugt, muss das erkennbar sein. Das Gesetz verlangt nicht, dass man aufhört — es verlangt, dass man es sagt.

Die kritische Stufe ist das hohe Risiko. Darunter fallen Systeme im Gesundheitswesen, in der Beschäftigung, im Bildungsbereich, in der Justiz, der Sicherheit oder bei wesentlichen Dienstleistungen — Bereiche, in denen ein Fehler nicht nur unangenehm ist. Er kann eine Tür schließen. Für diese Fälle verlangt der AI Act hochwertige Daten, technische Dokumentation, Sicherheitskontrollen und aktive menschliche Aufsicht. Nicht weil KI von Natur aus problematisch ist, sondern weil ihre Auswirkungen irreversibel sein können.

An der Spitze stehen inakzeptable Risiken: Praktiken, die Grundrechte verletzen und daher direkt verboten sind — darunter das soziale Scoring von Bürgerinnen und Bürgern, die massenhafte biometrische Echtzeitüberwachung in öffentlichen Räumen und die Emotionserkennung in Arbeits- oder Bildungsumgebungen.

Die Leseformel ist einfach: Je größer der Einfluss eines Systems auf das Leben eines Menschen, desto strenger die Anforderungen.

Die Spannung, die niemand benennen will

Das Interessanteste am AI Act steckt nicht in seinen Definitionen. Es steckt in dem Widerspruch, den er auszuhalten versucht.

Europa will regulieren. Aber Europa will auch wettbewerbsfähig bleiben. Und dieser zweite Teil geht in der Debatte meist verloren.

Während die Vereinigten Staaten, China und weite Teile des globalen Markts KI mit der Geschwindigkeit von Plattformen, Risikokapital und Talentkonzentration vorantreiben, versucht die EU einen geordneteren Weg einzuschlagen. Diese Wette hat einen offensichtlichen Vorteil: Sie schützt. Sie birgt aber auch ein reales Risiko: Werden die Regeln zu schwerfällig oder zu langsam, könnte Europa dabei zusehen, wie andere die Technologie in Geschäftsmodelle, Infrastruktur und geopolitische Macht verwandeln.

Deshalb erschöpft sich der europäische Ansatz nicht in der Norm. Die Kommission spricht auch von öffentlichen Investitionen, Talentförderung, Datenzugang, Hochleistungsrechnen, KI-Fabriken und direkter Unterstützung für Startups. Die Ambition: Technologie soll nicht in Dokumenten oder Laboren stecken bleiben, sondern Krankenhäuser, Industrien, Schulen, Verwaltungen und kleine Unternehmen erreichen. Das erklärte Ziel ist nicht, das Rennen zu verlangsamen, sondern es mit einem klareren Spielfeld zu bestreiten.

Ob das möglich ist — regulieren ohne zu hemmen, schützen ohne auszuschließen — ist die Frage, die der AI Act in den kommenden Jahren selbst beantworten muss. Das Gesetz existiert. Die Umsetzung noch nicht.

Was sich für Menschen ändert

Für Bürgerinnen und Bürger liegt das Entscheidende nicht in der technischen Sprache der Verordnung. Es liegt in der alltäglichen Konsequenz.

Wenn KI hilft, einen Film zu empfehlen, ist der Fehlerraum klein und der Preis eines Irrtums irrelevant. Wenn sie hilft zu entscheiden, wer eine Arbeitsstelle, eine Kreditgenehmigung oder eine medizinische Diagnose erhält, ändert sich die Geschichte grundlegend. Dann reicht es nicht mehr zu sagen: „Der Algorithmus hat entschieden." Es braucht Erklärung, die Möglichkeit zur Überprüfung und — wo nötig — Verantwortung.

KI hat keine eigene dunkle Seite. Sie wacht nicht mit Absichten auf. Die Probleme entstehen woanders: in schlecht gewählten Daten, in Systemen, die als unfehlbar vermarktet werden, in Organisationen, die automatisieren ohne zu prüfen, in Regierungen, die Technologie ohne Gegenkräfte einsetzen, in Nutzenden, die sie zum Werkzeug der Manipulation machen. Künstliche Intelligenz bringt keine eingebaute Moral mit. Sie verstärkt die Moral derer, die sie entwerfen, kaufen und anwenden.

Ein Wegweiser auf einer vollen Straße

Das ist vielleicht die treffendste Lesart des AI Act: keine Ethikmedaille und keine Bremse für die Zukunft. Sondern ein Versuch, Wegweiser auf eine Straße zu stellen, die bereits voll mit Verkehr ist — und die niemand mit einem Plan gebaut hat.

KI wird weiter voranschreiten, mit Europa oder ohne. Die Frage ist, ob sie das als schwarze Box tut — undurchsichtig, nicht prüfbar, ohne Verantwortliche — oder als Werkzeug, das klar genug ist, damit menschliche Verantwortung nicht hinter der Maschine verschwindet, wenn sie das Leben von jemandem berührt.

Der europäische Kompass zeigt in diese Richtung: eine KI, die nützlich, wettbewerbsfähig und transparent genug ist, damit Fehler gefunden, korrigiert — und nicht wiederholt werden.

Lernen und zertifizieren

Wenn dich dieses Thema interessiert und du verstehen möchtest, wie diese Regeln in Unternehmen, Plattformen, digitalen Produkten oder KI-Projekten angewendet werden, kannst du den Kurs machen und dich unter www.actactact.com zertifizieren lassen.

KI verändert bereits die digitale Welt. Ihre Regeln zu verstehen, wird zunehmend zu einem beruflichen Vorteil.